ChatGPTで急速に進化する“生成AI”に抱く「驚異」と「脅威」 東大教授・川原圭博氏が示す建設での可能性:Archi Future 2023(1/3 ページ)

ChatGPTの登場で進化スピードが一段と加速した生成AIや大規模基盤モデルは、今後の建設業界に何をもたらすのか。コンピュータネットワーク/ユビキタス専門家の東京大学大学院 工学系研究科 教授 川原圭博氏の講演にその答えを探る。

東京大学大学院 工学系研究科 教授 川原圭博氏が「Archi Future 2023」(会期:2023年10月26日、東京・有明TFTホール)に登壇し、「生成AIや大規模基盤モデルの特徴と建築分野への応用」のタイトルで講演した。

川原氏の講演内容は、OpenAIの生成AI「ChatGPT」の現在地に始まり、生成AIや大規模基盤モデルの特徴、AI進化の歴史、大規模基盤モデルの建設分野への応用可能性と、多岐にわたった。本稿では、その中から特に、建設に関連する部分を中心にレポートする。

予想を上回るスピードで進化する「ChatGPT」

講演導入で川原氏が取り上げた話題は、「ChatGPT」だ。川原氏は、日本語文書の多言語翻訳や2次方程式の計算と解法の解説、コンピュータプログラムの作成などをChatGPTで試し、その学習力の高さに感心させられたと漏らす。「ChatGPTは自然言語だけでなく、数学、プログラミング言語も深く学んでおり、人間でこれだけの教養を備える人は少ないだろう。AIは専門スキルを持つ人より、はるかに強力なパートナーに成り得る」(川原氏)。

川原氏は、ChatGPTのこうした能力の高さは建設分野でも力を発揮すると指摘。ChatGPTならば、住まい手や建物の利用者となる人たちの要望をマクロに積み上げ、実現のために必要な部材は何か、どういう手順でそれらを組み立てれば要望を満たす建築物が出来上がるかを、筋道を立てて理解して言語化できるからだ。

さらに川原氏は、OpenAIが2023年10月初旬に提供を始めた画像生成AI「DALL-E3」を実装したChatGPT Plusを使ってみて、その可能性を強く感じた。「近未来の家を生成してくださいと与えるだけで、イメージを作成した。4人家族に最適なレイアウトを考えて欲しいとの命題を与えると、はじめは言語的に内容を整理し、最終的に間取りとパースを生成。もちろん建築の専門家から見れば、破綻している部分も多いと思うが、素人の目には正直ここまできたのかと驚いた」(川原氏)。

LLMに感じる「驚異」と「脅威」

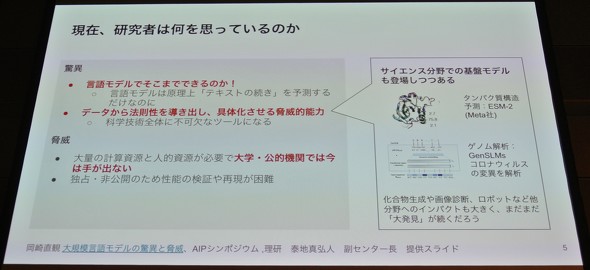

急速な進化を遂げるChatGPT。川原氏は、自然言語処理を専門とする東京工業大学 情報理工学院 情報工学系 教授 岡崎直観氏の論文を引用しながら、情報学系の研究者が、ChatGPTをはじめとする大規模言語モデル(LLM)に対し、「驚異」と「脅威」を抱いていると話す。

まず、「言語モデルでそこまで可能なのか」という驚異。川原氏は、言語モデルは原理上、テキストの続きを予測するものと前置きしたうえで、ChatGPTなどのLLMには、「たくさんのデータから法則性を導き出し、具体化させる能力が備わっているのではないか」と推測する。作業を抽象化して、具体的なものに落とし込む。それはまさに、さまざまな領域で研究者が実践する「研究的な営み」に他ならない。川原氏は、タンパク質の構造の予測やゲノム解析、ロボット研究などにLLMのような基盤モデルが使われ始めていることを紹介し、基盤モデルが科学技術全体に不可欠なツールになるのではと期待する。

一方の脅威とは、LLMが超大規模化することで、大学や公的研究機関では手を出せない状態になっていることだという。AIの性能を測る指標の一つにパラメータ数がある。パラメータ数の量が多いほど多くの情報を処理したり、複雑なタスクをこなしたりできるようになる。ChatGPTは非公開ながらGPT-3.5で1700億、GPT-4では5000億以上といわれているが、その規模になると1枚200〜300万円するGPUを数千〜数万枚使って数カ月間学習し続ける必要がある。川原氏は、そのGPU群を全てクラウドで調達するとなれば、数億円程度の投資が必要で、大学の研究室レベルではとうてい太刀打ちできないと危機感を示した。

さらに、インパクトの高い技術開発には大規模予算が付くため、その仕組みがなかなか公開されず、再現性を実証できない点も脅威になる。「再現性を実証できない技術を、サイエンスに使ってよいのかとの疑問を感じる」(川原氏)。

Copyright © ITmedia, Inc. All Rights Reserved.

人気記事トップ10

- 清水建設、大和ハウス工業、大林組が“BIMの先に”を議論 共通データ環境はAI基盤になるか?

- 「図面を“読む”から、完成形を“見る”へ」BIM×ARが埋める、ベテランと若手の認知格差

- 覆工コンクリート作業を自動化、2システムを組み合わせ作業員を半減 大林組

- 中東危機でシンナーも不足! 住宅建設に暗雲、国交省が異例の安定供給要請

- 土木×AIの「勝ち筋」とは? インフラや災害対応で進む“フィジカルAI”

- 難病を抱えながら設計者として働く「RDワーカー」のリアル 日建設計がNPO法人とシンポジウム

- 東京江東区に延べ15万m2の物流施設「DPL東京東雲」竣工、ヤマト最大級の統合型拠点に

- 清水建設がiPaaS「Workato」でデータ活用基盤構築 AIによる業務自動化を加速

- 千葉の地場ゼネコン「旭建設」が“新卒の離職率ゼロ”にできたワケ

- LIXILの「ビル用防火戸」で認定不適合、設置約3万8400棟 原因は点検プロセス

東京大学大学院 工学系研究科 教授 川原圭博氏 写真は全て筆者撮影

東京大学大学院 工学系研究科 教授 川原圭博氏 写真は全て筆者撮影