LLMのデータ言語化で進化する構造物点検 東大・全邦釘氏が提唱する「新時代のインフラマネジメント」:メンテナンス・レジリエンスTOKYO2025(1/2 ページ)

社会インフラは年を追うごとに老朽化が進み、維持管理の重要性が増している。しかし、人口減少と技術者不足の中で、従来の人手に頼る点検体制には限界がみえ始めている。こうした課題に対し、AIとデータを活用した新たなアプローチを提示するのが、東京大学大学院 工学系研究科 附属総合研究機構 特任教授で、土木学会のAI・データサイエンス論文集編集小委員会 委員長を務める全邦釘氏だ。

東京大学大学院 工学系研究科の全邦釘氏は、「メンテナンス・レジリエンスTOKYO2025」(会期:2025年7月23〜25日、東京ビッグサイト)の「事前防災・減災のための国土強靭化推進セミナー」で「AIとデータプラットフォームが拓くインフラメンテナンス」と題し、余剰データの活用、検出AIの限界、AIによる画像や状況の言語化など、点検の未来像が語られた。

今回の講演「AIとデータプラットフォームが拓くインフラメンテナンス」で全氏が示したのは、現場に存在する膨大なデータをAIで言語化して活用する手法だ。現場画像をAIで言語化すると、その後の情報抽出や解析が高精度で行える。さらに、言語化したデータとその後の処理の間も言語でつなぐと、処理の目的が明確になる。全氏は、LLM(大規模言語モデル)によるデータの言語化を中心に、ドローンや下水管ロボットの導入まで、多面的な未来像を紹介した。

再評価される「余剰データ」の活用

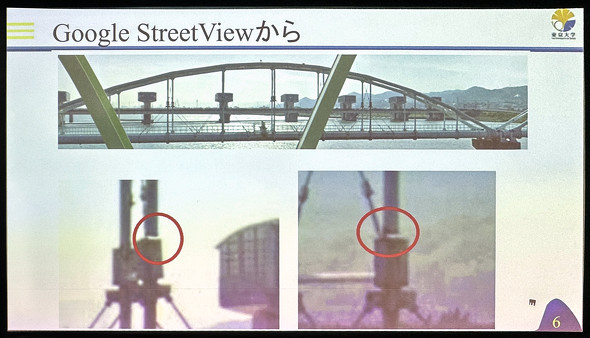

講演冒頭で全氏が示したのは、「偶然に蓄積されたデータの価値」だ。Google ストリートビューや旅行者が撮影した写真、自治体の広報用記録など、インフラ点検を目的とせずに撮影された画像データが、思いがけずインフラや施設の劣化を記録している場合がある。全氏は、このような画像データを「余剰データ」と表現。余剰データがインフラの老朽化度合いを知る重要な資料になることがあるとした。

その象徴的な事例が、2021年10月3日に起きた和歌山市の紀の川に架かる水道橋の崩落事故だ。10月9日朝まで約1週間にわたり、約6万世帯への給水が停止するなど甚大な影響が出た。その後の検証によって、事故の原因は橋の吊(つ)り材の腐食による破断と特定。しかし、実はこの橋が崩落する半年以上前に撮影されたGoogle ストリートビューの画像に、既に吊材が破断している状態が写り込んでいたことが判明した。

そのことは、既に取得したデータの中に、インフラ管理で非常に価値のある情報が潜んでいることを示している。このようなデータは、Googleストリートビューの他、監視カメラ、SNSの投稿、個人がスマートフォンで撮影した写真など、さまざまなデータプラットフォーム上に存在している。

しかし、全氏は「これまでの方法のままでは膨大なデータの中から“想定外”に有用な情報を得ることは現実的ではない」と話す。そこで、データプラットフォームから網羅的に情報を入手して解析する仕組みとしてのAI、かつ想定外に良い結果を得るようなAIが必要とし、これが新時代のインフラマネジメントになると提言した。

「言語化」でインフラメンテナンスがどう変わるのか

急激に進行する少子高齢化の中、AIが膨大な画像データやセンサーデータの中から自動的に異常を探し出す仕組みは、インフラメンテナンスの持続可能性を担保する上で不可欠な技術となる。ただ、AIにも苦手な部分はある。

全氏は「土木分野で世界的に研究が活発な分野は、画像から設備の損傷を検出するAIだ」と話す。高い精度を実現しており、コンクリート面の画像に対して、現在では98〜99%の精度でひび割れなどの損傷を検出できる。しかし、橋梁やトンネルでは通常、画像の明るさや汚れがバラバラのため、過去の学習データに性能が影響されるAIでは満足な精度を達成できないことが多い。そのため、正規化などによって学習データを整理し、意図しない環境でも不具合箇所の検出性能を上げるような試みが蓄積されてきた。全氏は、このような蓄積を経て、現時点では損傷の検出がおおむねできるという。

ただ、重要なのは、発見した損傷が「どのくらい危険なのか」だ。現時点でのAIは損傷は発見できるが、その損傷がどの構造要素にあたるのか、どれほど危ないのかは判別できない。全氏は「BIM/CIMやFEM(有限要素法による解析)とAIを融合する必要がある。そのためには構造や画像の理解が必要になる」と説く。

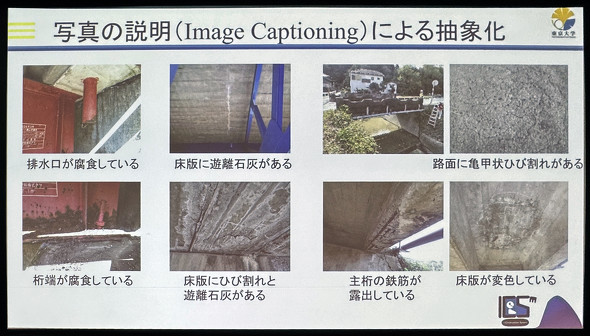

全氏は、こういった観点から2017年ごろから、画像や写真から何がどのような状態にあるかを文章で生成するAIの開発を開始したという。

全氏は、AIは写真に写っているモノや色などは判別できても、「ひび割れがある」とか「腐食がある」といった状況の理解は難しいと指摘する。そこで、画像から文章を生成して状態をいったん抽象化し、その文章を次のAIに渡す際に使う手法を試みた。

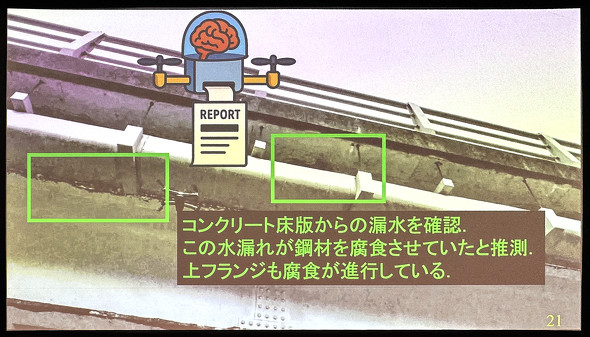

具体的には、ドローンを使って橋梁の裏側で損傷を探し、AIで解析して必要な処置や手順を言葉で表示した。個別要素はほぼそろっており、後はつなげるだけの段階にあるという。

言葉による状況説明は、人間が理解しやすいのはもちろん、AIで処理を行う際にも都合がよい。全氏は、その理由を「世の中には大量の文章があり、ChatGPTなどのAIは言葉を使って学習している」とする。

言葉で損傷の情報を与えると、ドローンはその箇所を確認する。そして、言葉によるレポートや点検調書を自動で作成する。

Copyright © ITmedia, Inc. All Rights Reserved.